(11 )

Dalam posting ini, kami akan menjelaskan algoritma lengkap untuk mengumpulkan inti semantik, terutama untuk situs informasi, tetapi pendekatan ini juga dapat diterapkan ke situs komersial.

Semantik awal dan pembuatan struktur situs

Persiapan kata-kata untuk penguraian dan struktur awal situs

Sebelum kita mulai menguraikan kata-kata, kita perlu mengetahuinya. Oleh karena itu, kita perlu membuat struktur awal situs kita dan kata-kata awal untuk penguraian (mereka juga disebut penanda).

Anda dapat melihat struktur asli dan kata-kata:

1. Menggunakan logika, kata-kata dari kepala (jika Anda memahami topik).

2. Dari pesaing Anda, yang Anda analisis saat memilih niche atau memasukkan kueri utama Anda.

3. Dari Wikipedia. Biasanya terlihat seperti ini:

4. Kami melihat wordstat untuk kueri utama Anda dan kolom kanan.

5. Buku tematik dan buku referensi lainnya.

Misalnya, topik situs kami adalah penyakit jantung. Jelas bahwa kita harus memiliki semua penyakit jantung dalam struktur kita.

Anda tidak dapat melakukannya tanpa buku pegangan medis. Saya tidak akan melihat pesaing, karena mereka mungkin tidak memiliki semua penyakit, kemungkinan besar mereka tidak punya waktu untuk menutupinya.

Dan kata-kata awal Anda untuk penguraian akan persis semua penyakit jantung, dan berdasarkan kunci yang kami urai, Anda akan membangun struktur situs saat Anda mulai mengelompokkannya.

Selain itu, Anda dapat mengambil semua obat untuk perawatan jantung, sebagai perpanjangan topik, dll. Anda melihat Wikipedia, judul dari pesaing di situs, wordstat, berpikir logis dan dengan cara ini menemukan lebih banyak kata penanda yang akan Anda urai.

Struktur situs

Anda dapat melihat pesaing untuk gambaran umum, tetapi Anda tidak selalu harus membuat struktur seperti milik mereka. Anda harus melanjutkan lebih dari logika Anda audiens sasaran, mereka juga memasukkan kueri yang Anda urai dari mesin telusur.

Misalnya, bagaimana melanjutkan? Daftar semua penyakit jantung, dan dari mereka sudah melakukan gejala, pengobatan. Atau, bagaimanapun, buat judul untuk gejala, pengobatan, dan darinya sudah menyebabkan penyakit. Masalah-masalah ini biasanya diselesaikan dengan pengelompokan kata kunci berdasarkan data mesin pencari. Tetapi tidak selalu, terkadang Anda harus membuat pilihan sendiri dan memutuskan bagaimana membuat struktur yang terbaik, karena permintaan dapat tumpang tindih.

Anda harus selalu ingat bahwa struktur dibuat di seluruh koleksi semantik dan kadang-kadang dalam bentuk aslinya terdiri dari beberapa judul, dan dengan pengelompokan dan koleksi lebih lanjut, itu berkembang saat Anda mulai melihat kueri dan logika. Dan terkadang Anda dapat menyusunnya dan tidak langsung khawatir tentang kata kunci, karena Anda tahu topiknya dengan baik atau diwakili dengan baik oleh pesaing. Tidak ada sistem untuk menyusun struktur situs, Anda dapat mengatakan ini adalah kreativitas pribadi Anda.

Strukturnya dapat menjadi individu Anda (berbeda dari pesaing), tetapi harus nyaman bagi orang-orang, memenuhi logika mereka, dan karena itu logika mesin pencari, dan sedemikian rupa sehingga Anda dapat mencakup semua kata tematik di niche Anda. Ini harus menjadi yang terbaik dan nyaman!

Pikirkan ke depan. Kebetulan Anda mengambil ceruk, dan kemudian Anda ingin mengembangkannya, dan Anda mulai mengubah struktur seluruh situs. Dan struktur yang dibuat di situs ini sangat sulit dan suram untuk diubah. Idealnya, Anda perlu mengubah url lampiran dan menempelkannya di situs itu sendiri. Singkatnya, betapa membosankan dan sangat bertanggung jawab pekerjaan itu, jadi segera putuskan sepenuhnya seperti seorang pria apa dan bagaimana Anda seharusnya!

Jika Anda sangat baru dengan subjek situs yang sedang dibuat dan tidak tahu bagaimana struktur akan dibangun, tidak tahu kata-kata awal apa yang harus diambil untuk penguraian, maka Anda dapat menukar tahap 1 dan 2 dari koleksi. Yaitu, pertama-tama mengurai pesaing (kami akan menganalisis cara menguraikannya di bawah), lihat kunci mereka, berdasarkan ini, buat struktur dan kata-kata awal untuk penguraian, lalu parsing wordstat, tip, dll.

Untuk mengkompilasi struktur, saya menggunakan manajer pikiran - Xmind. Ini gratis dan memiliki semua yang Anda butuhkan.

Struktur sederhana terlihat seperti ini:

Ini adalah struktur situs komersial. Biasanya di situs informasi tidak ada persimpangan dan filter kartu produk. Tetapi struktur ini juga tidak rumit, itu dikompilasi untuk dipahami klien. Biasanya struktur saya terdiri dari banyak panah dan persimpangan, komentar - hanya saya sendiri yang dapat menemukan struktur seperti itu.

Apakah mungkin untuk membuat semantik dalam proses mengisi situs?

Jika semantiknya mudah, Anda yakin dengan topiknya dan mengetahuinya, maka Anda bisa melakukan semantik secara paralel dengan konten situs. Tetapi struktur awal harus dibuang. Saya sendiri terkadang mempraktikkan ini di ceruk yang sangat sempit atau sangat lebar, agar tidak menghabiskan banyak waktu mengumpulkan semantik, tetapi untuk segera meluncurkan situs, tetapi saya tetap tidak menyarankan melakukan ini. Kemungkinan kesalahan sangat tinggi jika Anda tidak memiliki pengalaman. Namun, lebih mudah ketika semua semantik sudah siap, seluruh struktur sudah siap, dan semuanya tidak dikelompokkan dan dapat dimengerti. Selain itu, dalam semantik yang telah selesai, Anda dapat melihat kunci mana yang harus diprioritaskan, mana yang tidak memiliki persaingan dan akan mendatangkan lebih banyak pengunjung.

Di sini Anda juga perlu menolak ukuran situs, jika ceruknya lebar, maka tidak ada gunanya mengumpulkan semantik, lebih baik melakukannya di sepanjang jalan, karena bisa memakan waktu sebulan atau lebih untuk mengumpulkan semantik.

Jadi kami awalnya melemparkan struktur atau tidak, kami memutuskan untuk pergi dengan tahap kedua. Kami memiliki daftar kata atau frasa awal untuk topik kami yang dapat kami mulai parsing.

Parsing dan bekerja di keycollector

Untuk parsing tentunya saya menggunakan keycollector. Saya tidak akan memikirkan pengaturan keycollectora, Anda dapat membaca bantuan program ini atau menemukan artikel konfigurasi di Internet, ada banyak dan semuanya dijelaskan secara rinci di sana.

Saat memilih sumber gesekan, Anda harus menghitung biaya tenaga kerja dan efektivitasnya. Misalnya, jika Anda mengurai database Pastukhov atau MOAB, maka Anda akan menggali banyak permintaan sampah yang perlu disaring, dan inilah saatnya. Dan menurut saya, tidak ada gunanya menemukan beberapa permintaan. Ada studi yang sangat menarik tentang database dari RushAnalytics, tentu saja mereka memuji diri mereka sendiri di sana, tetapi jika Anda tidak memperhatikan ini, data yang sangat menarik tentang persentase kata kunci yang buruk http://www.rush-analytics.ru/ blog/analytica-istochnikov -semantik

Pada tahap pertama, saya mengurai wordstat, adwords, tips mereka dan menggunakan database kata kunci Bookvarix (versi desktop gratis). Saya juga biasa melihat-lihat tips dari Youtube secara manual. Namun baru-baru ini keycollector telah menambahkan kemampuan untuk menguraikannya, yang sangat bagus. Jika Anda benar-benar cabul, Anda dapat menambahkan basis kata kunci lain di sini.

Mulai parsing dan pergi kita pergi.

Membersihkan inti semantik untuk situs informasi

Kami menguraikan kueri dan kami mendapat daftar kata yang berbeda. Tentu saja, itu berisi kata-kata yang diperlukan, serta kata-kata sampah - kosong, tidak tematik, tidak relevan, dll. Karena itu, mereka perlu dibersihkan.

Saya tidak menghapus kata-kata yang tidak perlu, tetapi memindahkannya ke grup, karena:

- Di masa depan, mereka dapat menjadi bahan pemikiran dan memperoleh relevansi.

- Kami mengecualikan kemungkinan penghapusan kata secara tidak sengaja.

- Saat menguraikan atau menambahkan frasa baru, frasa tersebut tidak akan ditambahkan jika Anda mencentang kotak.

Saya terkadang lupa mengaturnya, jadi saya mengatur parsing dalam satu grup dan mengurai kunci hanya di dalamnya agar koleksi tidak terduplikasi:

Anda dapat bekerja dengan cara ini atau itu, mana yang nyaman bagi Anda.

Koleksi frekuensi

Kami mengumpulkan dari semua kata melalui langsung, frekuensi dasar [W] dan tepat [“!W”].

Segala sesuatu yang tidak menyatu, kami kumpulkan melalui wordstat.

Pembersihan satu kata dan non-format

Kami memfilter berdasarkan satu kata, melihatnya dan menghapus yang tidak perlu. Ada kueri satu kata yang tidak masuk akal untuk dilanjutkan, mereka tidak ambigu atau menduplikasi kueri satu kata lainnya.

Misalnya, kami memiliki topik - penyakit jantung. Dengan kata "hati" tidak ada gunanya bergerak maju, tidak jelas apa maksud seseorang - ini permintaan yang terlalu luas dan ambigu.

Kami juga melihat kata-kata mana yang tidak dikumpulkan oleh frekuensi - itu mengandung karakter khusus dalam kata-kata, atau ada lebih dari 7 kata dalam kueri, Kami mentransfernya ke non-format. Tidak mungkin permintaan semacam itu dimasukkan oleh orang-orang.

Menyikat dengan frekuensi keseluruhan dan tepat

Kami menghapus semua kata dengan frekuensi umum [W] dari 0 hingga 1.

Saya juga menghapus semuanya dari 0 hingga 1 sesuai dengan frekuensi yang tepat [”!W”].

Saya membagi mereka ke dalam kelompok yang berbeda. ![]()

Berikut ini, kata kunci logis normal dapat ditemukan dalam kata-kata ini. Jika kernelnya kecil, maka Anda dapat segera meninjau semua kata secara manual dengan frekuensi nol dan pergi, yang menurut Anda, dimasukkan orang. Ini akan membantu untuk menutupi topik sepenuhnya dan ada kemungkinan orang akan mengikuti kata-kata seperti itu. Tapi tentu saja, kata-kata ini harus digunakan terakhir, karena menurut mereka lalu lintas besar pasti tidak akan.

Nilai dari 0 hingga 1 juga diambil berdasarkan topik, jika kata kunci banyak, maka Anda dapat memfilter dari 0 hingga 10. Artinya, itu semua tergantung pada luasnya topik dan preferensi Anda.

Sepatu berdasarkan liputan

Teorinya di sini adalah sebagai berikut: misalnya, ada kata - "forum", frekuensi dasarnya adalah 8.136.416, dan frekuensi tepatnya adalah 24.377, seperti yang kita lihat perbedaannya lebih dari 300 kali. Oleh karena itu, kita dapat berasumsi bahwa permintaan ini kosong, termasuk banyak ekor.

Oleh karena itu, dengan semua kata, saya menghitung, KEI tersebut:

Frekuensi halus / Frekuensi dasar * 100% = cakupan cakupan

Semakin rendah persentasenya, semakin besar kemungkinan kata tersebut kosong.

Di KeyCollector rumus ini terlihat seperti ini:

YandexWordstatQuotePointFreq / (YandexWordstatBaseFreq+0.01) * 100

Di sini juga, semuanya tergantung pada subjek dan jumlah frasa dalam inti, sehingga Anda dapat menghapus kelengkapan cakupan kurang dari 5%. Dan di mana intinya besar, maka Anda tidak dapat mengambil bahkan 10-30%.

Bersihkan dengan duplikat implisit

Untuk membersihkan duplikat implisit, kita perlu mengumpulkan frekuensi AdWords dari mereka dan menavigasinya, karena ini memperhitungkan urutan kata. Kami menghemat sumber daya, jadi kami akan mengumpulkan indikator ini bukan dari seluruh inti, tetapi hanya dari duplikat.

Dengan cara ini, kami menemukan dan menandai semua duplikat yang tidak jelas. Tutup tab - Analisis duplikat implisit. Mereka menandai kita di kelompok kerja. Sekarang kami hanya akan menampilkannya, karena parameternya hanya diambil dari frasa yang telah kami tampilkan di grup saat ini. Dan baru kemudian kita mulai menguraikan.

Kami menunggu AdWords untuk mengambil indikator dan masuk ke analisis duplikat implisit.

Kami menetapkan parameter ini dari tanda grup pintar dan klik - lakukan pemeriksaan cerdas. Dengan cara ini, hanya kueri AdWords dengan frekuensi tertinggi yang tidak akan ditandai dalam grup duplikat kami.

Tentu saja, lebih baik untuk memeriksa semua duplikat dan melihat secara manual, tiba-tiba ada sesuatu yang salah di sana. Berikan perhatian khusus pada kelompok di mana tidak ada indikator frekuensi, di mana duplikat ditandai secara kebetulan.

Segala sesuatu yang Anda tandai dalam analisis kelompok implisit, juga dimasukkan ke dalam kelompok kerja. Jadi setelah analisis selesai, tutup saja tab dan pindahkan semua duplikat implisit yang ditandai ke folder yang sesuai.

Membersihkan dengan kata-kata berhenti

Stop word juga saya bagi menjadi beberapa kelompok. Secara terpisah saya akan membawa kota-kota. Mereka mungkin berguna di masa depan jika kita memutuskan untuk membuat direktori organisasi.

Secara terpisah, saya memasukkan kata-kata yang berisi kata-kata foto, video. Suatu hari mereka akan berguna.

Dan juga, "permintaan vital", misalnya, Wikipedia, saya sertakan forum di sini, serta dalam topik medis, ini mungkin termasuk - Malyshev, nyamuk, dll.

Itu semua tergantung pada subjek juga. Anda juga dapat membuat permintaan komersial terpisah - harga, beli, simpan.

Ternyata di sini adalah daftar grup dengan kata berhenti:

Membersihkan kata-kata yang bengkok

Ini berlaku untuk topik kompetitif, mereka sering ditipu oleh pesaing untuk menyesatkan Anda. Oleh karena itu, perlu untuk mengumpulkan musiman dan menyingkirkan semua kata dengan median sama dengan 0.

Dan juga, Anda dapat melihat rasio frekuensi dasar dengan rata-rata, perbedaan besar juga dapat menunjukkan permintaan curang.

Tetapi Anda perlu memahami bahwa indikator ini juga dapat menunjukkan bahwa ini adalah kata-kata baru yang statistiknya baru saja muncul atau hanya musiman.

Pembersihan oleh geo

Biasanya pemeriksaan oleh geo untuk situs informasi tidak diperlukan, tetapi untuk berjaga-jaga, saya akan menandatangani saat ini.

Jika ada keraguan bahwa beberapa permintaan bergantung secara geografis, maka lebih baik untuk memeriksanya melalui koleksi Rookee, meskipun terkadang membuat kesalahan, tetapi jauh lebih jarang daripada memeriksa parameter ini oleh Yandex. Kemudian, setelah mengumpulkan Rookee, ada baiknya memeriksa semua kata secara manual, yang ditunjukkan sebagai tergantung-geo.

Pembersihan manual

Sekarang inti kami telah menjadi beberapa kali lebih kecil. Kami meninjaunya secara manual dan menghapus frasa yang tidak perlu.

Hasilnya, kami mendapatkan grup kernel berikut:

Kuning - layak digali, Anda dapat menemukan kata-kata untuk masa depan.

Oranye - dapat berguna jika kami memperluas situs dengan layanan baru.

Merah - tidak berguna.

Analisis persaingan permintaan untuk situs informasi

Setelah mengumpulkan permintaan dan membersihkannya, sekarang kita perlu memeriksa persaingan mereka untuk memahami di masa depan permintaan apa yang harus ditangani terlebih dahulu.

Persaingan dalam jumlah dokumen, judul, halaman utama

Ini semua dengan mudah dihapus melalui KEI di KeyCollector.

Kami mendapatkan data untuk setiap permintaan, berapa banyak dokumen yang ditemukan di mesin pencari, dalam contoh kami di Yandex. Berapa banyak halaman utama dalam hasil untuk permintaan ini dan kemunculan permintaan dalam judul.

Di Internet, Anda dapat menemukan berbagai formula untuk menghitung indikator ini, bahkan tampaknya di KeyCollector yang baru diinstal, menurut standar, ada semacam formula untuk menghitung KEI. Tetapi saya tidak mengikuti mereka, karena Anda perlu memahami bahwa masing-masing faktor ini memiliki berat yang berbeda. Misalnya, yang paling penting adalah keberadaan halaman utama di hasil pencarian, kemudian judul dan jumlah dokumen. Tidak mungkin bahwa pentingnya faktor ini entah bagaimana dapat diperhitungkan dalam rumus, dan jika masih memungkinkan, maka Anda tidak dapat melakukannya tanpa ahli matematika, tetapi kemudian rumus ini tidak akan dapat masuk ke dalam kemampuan KeyCollector .

Tautkan persaingan pasar

Di sini lebih menarik. Setiap pertukaran memiliki algoritme sendiri untuk menghitung persaingan, dan dapat diasumsikan bahwa mereka memperhitungkan tidak hanya keberadaan halaman utama dalam hasil pencarian, tetapi juga usia halaman, massa tautan, dan parameter lainnya. Pada dasarnya, pertukaran ini, tentu saja, dirancang untuk permintaan komersial, tetapi tetap saja, sedikit banyak kesimpulan dapat ditarik dari permintaan informasi.

Kami mengumpulkan data di bursa dan menampilkan rata-rata dan sudah fokus pada mereka.

Saya biasanya mengumpulkan di 2-3 bursa. Hal utama adalah bahwa semua permintaan dikumpulkan untuk pertukaran yang sama dan jumlah rata-rata diturunkan hanya untuk mereka. Dan tidak sehingga beberapa permintaan dikumpulkan oleh beberapa pertukaran, dan yang lainnya oleh yang lain, dan mereka menyimpulkan rata-rata.

Untuk tampilan yang lebih visual, Anda dapat menerapkan rumus KEI, yang akan menunjukkan biaya satu pengunjung berdasarkan parameter pertukaran:

KEI = AverageBudget / (AverageTraffic +0,01)

Bagi anggaran rata-rata untuk bursa dengan perkiraan lalu lintas rata-rata untuk bursa, kami mendapatkan biaya per pengunjung berdasarkan data bursa.

kompetisi mutagen

Itu tidak ada di keycollector, tapi itu tidak masalah. Tanpa masalah, semua kata dapat diunggah ke Excel, dan kemudian dijalankan melalui KeyCollector.

Mengapa Keyso lebih baik? Ini memiliki basis yang lebih besar daripada pesaingnya. Itu bersih, tidak ada frasa yang digandakan dan ditulis dalam urutan yang berbeda. Misalnya, Anda tidak akan menemukan kunci berulang seperti "diabetes tipe 1", "diabetes tipe 1" di sana.

Keyso juga tahu cara memecat situs dengan satu penghitung Adsense, Analytics, Leadia, dll. Anda dapat melihat situs lain apa yang ada dari pemilik situs yang dianalisis. Ya, dan secara umum, dalam hal mencari situs pesaing, saya pikir ini adalah solusi terbaik.

Bagaimana cara bekerja dengan Keyso?

Kami mengambil salah satu situs pesaing kami, tentu saja lebih baik, tetapi tidak terlalu kritis. Karena kita akan bekerja dalam dua iterasi, masukkan di kolom. Zhmakaem - menganalisis.

Kami mendapatkan informasi di situs, kami tertarik dengan pesaing di sini, klik buka semua.

Kami membuka semua pesaing.

Ini semua adalah situs yang entah bagaimana tumpang tindih dengan kata kunci dengan situs kami yang dianalisis. Akan ada youtube.com, otvet.mail.ru, dll., yaitu portal besar yang menulis tentang segalanya. Kami tidak membutuhkan mereka, kami membutuhkan situs murni hanya pada subjek kami. Oleh karena itu, kami memfilternya sesuai dengan kriteria berikut.

Kesamaan adalah persentase kunci umum dalam jumlah total domain ini.

Tematisitas - jumlah kunci situs kami yang dianalisis dalam kunci domain pesaing.

Oleh karena itu, persimpangan parameter ini akan menghapus situs bersama.

Kami menempatkan tema 10, kesamaan 4 dan melihat apa yang kami dapatkan.

Ternyata 37 pesaing. Tapi tetap saja, kami masih akan memeriksanya secara manual, mengunggahnya ke Excel, dan jika perlu, hapus yang tidak perlu.

Sekarang buka tab laporan grup dan masukkan semua pesaing kami yang kami temukan di atas. Klik untuk menganalisis.

Kami mendapatkan daftar kata kunci untuk semua situs ini. Tapi kami belum sepenuhnya mengungkapkan topiknya. Karena itu, kami pindah ke grup pesaing.

Dan sekarang kita mendapatkan semua pesaing, semua situs yang telah kita masuki. Ada beberapa kali lebih banyak dan ada juga banyak yang tematik umum. Kami memfilternya berdasarkan kesamaan, katakanlah 30.

Kami mendapatkan 841 pesaing.

Di sini kita bisa melihat berapa banyak halaman yang dimiliki situs ini, lalu lintas dan menarik kesimpulan tentang pesaing mana yang paling efektif.

Kami mengekspor semuanya ke Excel. Kami memilah-milah tangan kami dan hanya menyisakan pesaing ceruk kami, kami dapat menandai kawan yang paling efektif untuk mengevaluasi mereka nanti dan melihat chip apa yang mereka miliki di situs, kueri yang memberikan banyak lalu lintas.

Sekarang kita kembali ke laporan grup dan menambahkan semua pesaing yang telah kita temukan dan mendapatkan daftar kata kunci.

Disini kita bisa langsung memfilter daftar berdasarkan “!wordstat” Lebih dari 10.

Ini adalah permintaan kami, sekarang kami dapat menambahkannya ke KeyCollector dan menentukan bahwa frasa yang sudah ada di grup KeyCollector lain tidak ditambahkan.

Sekarang kami membersihkan kunci kami, dan memperluas, mengelompokkan inti semantik kami.

Layanan pengumpulan inti semantik

Dalam industri ini, Anda dapat menemukan beberapa organisasi yang siap menawarkan layanan clustering kepada Anda. Misalnya, jika Anda tidak mau meluangkan waktu untuk mempelajari seluk-beluk pengelompokan dan melakukannya sendiri, ada banyak orang di luar sana yang bersedia melakukan pekerjaan itu.

Yadrex

Salah satu yang pertama di pasar yang mulai menggunakan kecerdasan buatan untuk membuat inti sematic. Kepala perusahaan itu sendiri adalah seorang webmaster profesional dan spesialis dalam teknologi SEO, jadi dia menjamin kualitas kerja karyawannya.

Selain itu, Anda dapat menghubungi nomor yang ditunjukkan untuk mendapatkan jawaban atas semua pertanyaan Anda tentang pekerjaan.

Saat memesan layanan, Anda akan menerima file yang berisi grup konten kernel dan strukturnya. Selain itu, Anda mendapatkan struktur di mindmup.

Biaya pekerjaan bervariasi tergantung pada volume, semakin besar volume pekerjaan, semakin murah biaya satu kunci. Biaya maksimum untuk proyek informasi akan menjadi 2,9 rubel untuk satu kunci. Untuk penjual 4,9 rubel per kunci. Diskon dan bonus disediakan untuk pesanan besar.

Kesimpulan

Ini melengkapi pembuatan inti semantik untuk situs informasi.

Saya menyarankan Anda untuk memantau riwayat perubahan program KeyCollector, karena program ini terus-menerus dilengkapi dengan alat baru, misalnya, youtube untuk parsing baru-baru ini ditambahkan. Dengan bantuan alat baru, Anda dapat lebih memperluas inti semantik Anda.

Jika Anda tahu rasa sakit dari "tidak suka" mesin pencari untuk halaman toko online Anda, baca artikel ini. Saya akan berbicara tentang jalur untuk meningkatkan visibilitas situs, atau lebih tepatnya, tentang tahap pertama - mengumpulkan kata kunci dan menyusun inti semantik. Tentang algoritme untuk pembuatannya dan alat yang digunakan untuk ini.

Pesan kumpulan inti semantik dari spesialis SEO dari agensi Netpeak:

Mengapa membuat inti semantik?

Untuk meningkatkan visibilitas halaman situs. Buat agar Yandex dan robot pencarian Google mulai menemukan halaman situs Anda atas permintaan pengguna. Tentu saja, mengumpulkan kata kunci (menyusun semantik) adalah langkah pertama menuju tujuan ini. Selanjutnya, "kerangka" bersyarat dilemparkan untuk mendistribusikan kata kunci sesuai dengan yang berbeda halaman arahan. Dan kemudian artikel / meta tag sudah ditulis dan diimplementasikan.

Omong-omong, di Internet Anda dapat menemukan banyak definisi inti semantik.

1. "Inti semantik adalah kumpulan kata pencarian yang teratur, bentuk morfologisnya, dan frasa yang paling akurat mencirikan jenis aktivitas, produk, atau layanan yang ditawarkan oleh situs." Wikipedia.

Untuk mengumpulkan semantik pesaing di Serpstat, masukkan salah satu kueri utama, pilih wilayah, klik "Cari" dan buka kategori "Analisis Kata Kunci". Kemudian pilih "Analisis SEO" dan klik "Pilih Frasa". Hasil ekspor:

2.3. Menggunakan Kolektor Kunci/Slovoeb untuk membuat inti semantik

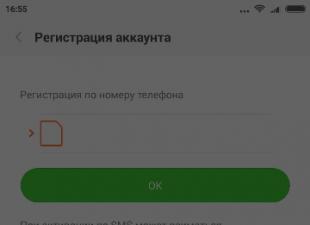

Jika Anda perlu membuat inti semantik untuk toko online besar, Anda tidak dapat melakukannya tanpa Kolektor Kunci. Tetapi jika Anda seorang pemula, maka akan lebih mudah menggunakan alat gratis - Slovoeb (biarkan nama ini tidak membuat Anda takut). Unduh program, dan dalam pengaturan Yandex.Direct, tentukan login dan kata sandi untuk Yandex.Mail Anda:  Buat proyek baru. Di tab "Data", pilih fungsi "Tambahkan frasa". Pilih wilayah dan masukkan permintaan yang Anda terima sebelumnya:

Buat proyek baru. Di tab "Data", pilih fungsi "Tambahkan frasa". Pilih wilayah dan masukkan permintaan yang Anda terima sebelumnya:  Tip: buat proyek terpisah untuk masing-masing domain baru, dan buat grup terpisah untuk setiap kategori/laman landas. Sebagai contoh:

Tip: buat proyek terpisah untuk masing-masing domain baru, dan buat grup terpisah untuk setiap kategori/laman landas. Sebagai contoh:  Sekarang kumpulkan semantik dari Yandex.Wordstat. Buka tab "Pengumpulan data" - "Koleksi kumpulan kata dari kolom kiri Yandex.Wordstat". Di jendela yang terbuka, pilih kotak centang "Jangan tambahkan frasa jika sudah ada di grup lain." Masukkan beberapa frasa (frekuensi tinggi) paling populer di antara pengguna dan klik "Mulai mengumpulkan":

Sekarang kumpulkan semantik dari Yandex.Wordstat. Buka tab "Pengumpulan data" - "Koleksi kumpulan kata dari kolom kiri Yandex.Wordstat". Di jendela yang terbuka, pilih kotak centang "Jangan tambahkan frasa jika sudah ada di grup lain." Masukkan beberapa frasa (frekuensi tinggi) paling populer di antara pengguna dan klik "Mulai mengumpulkan":

Omong-omong, untuk proyek besar di Key Collector, Anda dapat mengumpulkan statistik dari layanan analisis pesaing SEMrush, SpyWords, Serpstat (mis. Prodvigator) dan sumber tambahan lainnya.

Pada tahun 2008 saya membuat proyek Internet pertama saya.

Itu adalah toko elektronik online yang membutuhkan promosi.

Awalnya, pekerjaan promosi diserahkan kepada programmer yang membuatnya.

Apa yang harus dipromosikan?

Mereka menyusun daftar kunci dalam 5 menit: ponsel, camcorder, kamera, iPhone, Samsung - semua kategori dan produk di situs.

Ini adalah nama-nama umum yang sama sekali tidak menyerupai inti semantik yang disusun dengan benar.

Waktu yang lama berlalu tanpa hasil.

Laporan yang tidak dapat dipahami dipaksa untuk mencari pemain yang berspesialisasi dalam promosi situs web.

Saya menemukan perusahaan lokal, mempercayakan proyek tersebut kepada mereka, tetapi bahkan di sini semuanya sia-sia.

Kemudian muncul pemahaman bahwa profesional sejati harus terlibat dalam promosi.

Setelah membaca banyak ulasan, saya menemukan salah satunya freelancer terbaik yang menjamin keberhasilan.

Enam bulan kemudian, tidak ada hasil lagi.

Kurangnya hasil dalam organik selama dua tahun yang membawa saya ke SEO.

Selanjutnya, ini menjadi panggilan utama.

Sekarang saya mengerti apa yang salah dalam promosi awal saya.

Kesalahan ini diulangi oleh sebagian besar bahkan spesialis SEO berpengalaman yang telah menghabiskan lebih dari satu tahun mempromosikan situs web.

Kesalahan berada di pekerjaan yang salah dengan kata kunci.

Bahkan, tidak ada pemahaman tentang apa yang kita promosikan.

Tidak ada waktu untuk mengumpulkan inti semantik, cepat isi detail kontak.

Inti semantik (disingkat SN) adalah daftar kata kunci spesifik yang menggambarkan tema situs sebanyak mungkin.

Mengapa Anda perlu membuat inti semantik situs

- inti semantik mencirikan, berkat robot yang mengindeks halaman tidak hanya menentukan kealamian teks, tetapi juga subjek untuk membawa halaman ke bagian pencarian yang sesuai. Jelas bahwa robot bekerja dengan otonomi penuh setelah memasukkan alamat halaman situs ke dalam basis sumber daya pencarian;

- ditulis dengan baik adalah dasar semantik situs dan mencerminkan struktur yang sesuai untuk promosi SEO;

- setiap halaman situs, masing-masing, terkait dengan bagian tertentu dari CL dari sumber daya web;

- berkat inti semantik, strategi promosi di mesin pencari terbentuk;

- menurut inti semantik, Anda dapat memperkirakan berapa biaya promosi.

Aturan dasar untuk menyusun inti semantik

Untuk merakit SA, Anda perlu merakit set kata kunci. Dalam hal ini, Anda perlu mengevaluasi kekuatan Anda dalam kaitannya dengan promosi kueri frekuensi tinggi dan menengah. Jika Anda ingin mendapatkan pengunjung terbanyak dengan anggaran terbatas, Anda perlu menggunakan kueri frekuensi tinggi dan menengah. Jika sebaliknya, maka permintaan frekuensi menengah dan rendah.

Bahkan jika Anda memiliki anggaran tinggi, tidak masuk akal untuk mempromosikan situs hanya untuk kueri frekuensi tinggi. Seringkali permintaan seperti itu juga karakter umum dan beban semantik yang tidak ditentukan, misalnya, "mendengarkan musik", "berita", "olahraga".

Saat memilih kueri penelusuran, mereka menganalisis serangkaian indikator yang sesuai dengan frasa penelusuran:

- jumlah tayangan (frekuensi);

- jumlah tayangan tanpa perubahan morfologi dan kombinasi kata;

- halaman yang dikeluarkan oleh mesin pencari saat memasukkan permintaan pencarian;

- halaman dalam pencarian TOP untuk kueri utama;

- memperkirakan biaya promosi sesuai permintaan;

- kompetisi kata kunci;

- prediksi jumlah transisi;

- rasio pentalan (menutup situs setelah mengklik tautan) dan musiman layanan;

- kata kunci geo-dependency (lokasi geografis perusahaan dan pelanggannya).

Bagaimana membangun inti semantik

Dalam praktiknya, pemilihan inti semantik dapat dilakukan dengan metode berikut:

Situs web pesaing dapat menjadi sumber kata kunci untuk inti semantik. Di sinilah Anda dapat dengan cepat mengambil kata kunci, serta menentukan frekuensi "lingkungan" mereka menggunakan analisis semantik. Untuk melakukan ini, Anda perlu membuat penilaian semantik dari halaman teks, kata-kata yang paling banyak disebutkan membentuk inti morfologis;

Kami merekomendasikan untuk membentuk inti semantik Anda sendiri berdasarkan statistik layanan khusus. Gunakan, misalnya, Wordstat Yandex- sistem statistik mesin pencari Yandex. Di sini Anda dapat melihat frekuensi permintaan pencarian, serta mengetahui apa yang dicari pengguna bersama dengan kata kunci ini;

"Tips" sistem muncul ketika Anda mencoba memasukkan frasa pencarian di garis interaktif. Kata dan frasa ini juga dapat masuk ke SL sebagai kata yang terhubung;

Basis data kueri penelusuran tertutup, misalnya, basis data Pastukhov, dapat menjadi sumber kata kunci untuk CL. Ini adalah larik data khusus yang berisi informasi tentang kombinasi kueri penelusuran yang efektif;

Statistik situs internal juga dapat menjadi sumber data tentang kueri penelusuran yang menarik bagi pengguna. Ini berisi informasi tentang sumber dan mengetahui dari mana pembaca berasal, berapa banyak halaman yang mereka lihat dan dari browser apa mereka berasal.

Alat gratis untuk mengkompilasi inti semantik:

Yandex.Wordstat- alat gratis populer yang digunakan dalam menyusun inti semantik. Dengan menggunakan layanan ini, Anda dapat mengetahui berapa kali pengunjung memasukkan kueri tertentu ke mesin pencari Yandex. Memberikan kesempatan untuk menganalisis dinamika permintaan untuk kueri ini berdasarkan bulan.

Google AdWords adalah salah satu sistem yang paling banyak digunakan untuk meninggalkan inti semantik situs. Dengan bantuan Google Keyword Planner, Anda dapat menghitung dan memperkirakan tayangan kueri tertentu di masa mendatang.

Yandex.Langsung banyak pengembang menggunakan kata kunci yang paling menguntungkan untuk pemilihan. Jika di masa depan direncanakan untuk menempatkan iklan di situs, maka pemilik sumber daya dengan pendekatan ini akan menerima keuntungan yang baik.

Slovoeb- adik dari Kay Collector, yang terbiasa mengkompilasi inti semantik situs. Data dari Yandex diambil sebagai dasar. Di antara kelebihannya, orang dapat mencatat antarmuka yang intuitif, serta aksesibilitas tidak hanya untuk para profesional, tetapi juga untuk pemula yang baru mulai terlibat dalam analisis SEO.

Alat berbayar untuk menyusun inti semantik:

Pangkalan Pastukhov menurut banyak ahli tidak memiliki pesaing. Basis data menampilkan permintaan yang tidak ditampilkan oleh Google maupun Yandex. Ada banyak fitur lain yang melekat dalam database Max Pastukhov, di antaranya shell perangkat lunak yang nyaman dapat dicatat.

kata-kata mata-mata- Alat menarik yang memungkinkan Anda menganalisis kata kunci pesaing. Dengan bantuannya, Anda dapat melakukan analisis komparatif inti semantik dari sumber daya yang diinginkan, serta mendapatkan semua data tentang perusahaan PPC dan SEO pesaing. Sumber dayanya berbahasa Rusia, tidak akan ada masalah untuk menangani fungsinya.

Program berbayar yang dibuat khusus untuk para profesional. Membantu menyusun inti semantik dengan mengidentifikasi kueri yang relevan. Ini digunakan untuk memperkirakan biaya mempromosikan sumber daya untuk kata kunci yang menarik. Selain tingkat efisiensi yang tinggi, program ini menonjol karena kemudahan penggunaannya.

SEMrush memungkinkan Anda menentukan kata kunci yang paling efektif berdasarkan data dari sumber daya yang bersaing. Dengan bantuannya, Anda dapat memilih kueri frekuensi rendah, yang ditandai dengan level tinggi lalu lintas. Seperti yang diperlihatkan oleh praktik, untuk permintaan seperti itu, sangat mudah untuk mempromosikan sumber daya ke posisi pertama masalah.

SeoLib- layanan yang telah mendapat kepercayaan dari pengoptimal. Memiliki banyak fungsi. Memungkinkan Anda menyusun inti semantik secara kompeten, serta melakukan tindakan analitis yang diperlukan. Dalam mode bebas, Anda dapat menganalisis 25 permintaan per hari.

promotor memungkinkan Anda untuk merakit inti semantik utama hanya dalam beberapa menit. Ini adalah layanan yang digunakan terutama untuk analisis situs yang bersaing, serta untuk pemilihan kueri kunci yang paling efektif. Analisis kata dipilih untuk Google di Rusia atau untuk Yandex di wilayah Moskow.

Inti semantik dirakit cukup cepat jika sumber dan database digunakan sebagai petunjuk.

Proses berikut harus dibedakan:

Menurut konten situs dan topik yang relevan dipilih kata kunci, yang paling akurat mencerminkan arti portal web Anda.

- Dari set yang dipilih, yang berlebihan dihilangkan, mungkin kueri yang dapat memperburuk pengindeksan sumber daya. Penyaringan kata kunci dilakukan berdasarkan hasil analisis yang dijelaskan di atas.

- Inti semantik yang dihasilkan harus didistribusikan secara merata di antara halaman-halaman situs, jika perlu, teks dengan tema dan volume kata kunci tertentu dipesan.

Contoh pengumpulan inti semantik menggunakan layanan Wordstat Yandex

Misalnya, Anda mempromosikan salon kuku di Moskow.

Kami memikirkan dan memilih semua jenis kata yang sesuai dengan tema situs.

Kegiatan perusahaan

- salon manikur;

- salon layanan kuku;

- studio layanan kuku

- studio manikur;

- studio pedikur;

- studio desain kuku

Nama layanan umum

Pedikur;

- manikur;

- ekstensi kuku.

Sekarang kita pergi ke layanan Yandex dan memasukkan setiap permintaan, setelah memilih wilayah yang akan kita pindahkan.

Kami menyalin semua kata di Excel dari kolom kiri, ditambah frasa bantu dari kanan.

Kami menghapus kata-kata yang tidak perlu yang tidak sesuai dengan topik. Kata-kata yang cocok disorot dengan warna merah di bawah ini.

Angka 2320 permintaan menunjukkan berapa kali orang mengetik permintaan ini tidak hanya dalam bentuk murni, tetapi juga sebagai bagian dari frasa lain. Misalnya: manikur dan harga di Moskow, harga manikur dan pedikur di Moskow, dll.

Jika Anda memasukkan kueri kami dalam tanda kutip, maka akan ada gambar lain, yang memperhitungkan bentuk kata dari frasa kunci. misalnya: harga manikur, harga manikur, dll.

Jika Anda memasukkan kueri kueri yang sama dalam tanda kutip dengan tanda seru, kita akan melihat berapa kali pengguna mengetikkan kueri "harga manikur".

Selanjutnya, kami memecah daftar kata yang dihasilkan ke dalam halaman situs. Jadi, misalnya, kami akan meninggalkan permintaan frekuensi tinggi di halaman utama dan di bagian utama situs, seperti: manikur, studio layanan kuku, ekstensi kuku. Kami akan mendistribusikan frekuensi menengah dan frekuensi rendah di sisa halaman, misalnya: harga manikur dan pedikur, desain ekstensi kuku gel. Kata-kata juga harus dibagi menjadi kelompok-kelompok menurut artinya.

- Halaman utama - studio, salon perawatan kuku, dll.

- 3 bagian - pedikur, manikur, harga manikur dan pedikur.

- Halaman - ekstensi kuku, pedikur perangkat keras, dll.

Kesalahan apa yang bisa dilakukan saat menyusun a

Saat menyusun inti semantik, tidak ada yang kebal dari kesalahan. Yang paling umum termasuk yang berikut:

- Selalu ada bahaya memilih kueri yang tidak efisien yang menghasilkan jumlah pengunjung minimum.

- Saat kembali mempromosikan situs, Anda tidak boleh sepenuhnya mengubah konten yang diposting di situs. Jika tidak, semua parameter sebelumnya akan disetel ulang ke nol, termasuk peringkat dalam hasil pencarian.

- Anda tidak boleh menggunakan kueri yang salah untuk bahasa Rusia, robot pencarian sudah mendefinisikan kueri tersebut dengan baik dan menghapus halaman dari pencarian saat mereka "spam" dengan kata kunci.

Semoga Anda beruntung dalam mempromosikan situs Anda!

Halo, para pembaca situs blog yang terhormat. Saya ingin membuat panggilan lain dengan topik "mengumpulkan benih." Pertama, seperti yang diharapkan, dan kemudian banyak latihan, mungkin sedikit canggung dalam penampilan saya. Jadi, lirik. Saya lelah berjalan dengan mata tertutup untuk mencari keberuntungan setahun setelah memulai blog ini. Ya, ada “lucky hit” (tebakan intuitif dari kueri yang sering ditanyakan ke mesin pencari) dan ada beberapa lalu lintas dari mesin pencari, tetapi saya ingin mencapai target setiap saat (setidaknya untuk melihatnya).

Kemudian saya menginginkan lebih - untuk mengotomatiskan proses pengumpulan permintaan dan menyaring "boneka". Untuk alasan ini, ada pengalaman dengan Keycollector (dan adik laki-lakinya yang tidak harmonis) dan artikel lain tentang topik tersebut. Semuanya hebat dan bahkan hebat, sampai saya menyadari bahwa ada satu hal penting yang pada dasarnya tetap berada di belakang layar - permintaan artikel yang tersebar.

Menulis artikel terpisah untuk permintaan terpisah dibenarkan baik dalam topik yang sangat kompetitif atau yang sangat menguntungkan. Untuk situs informasi, ini benar-benar omong kosong, dan oleh karena itu pertanyaan harus digabungkan dalam satu halaman. Bagaimana? Secara intuitif, yaitu lagi membabi buta. Tetapi tidak semua permintaan cocok di satu halaman dan setidaknya memiliki peluang hipotetis untuk mencapai Puncak.

Sebenarnya, hari ini kita akan berbicara tentang pengelompokan otomatis inti semantik menggunakan KeyAssort (memecah permintaan menjadi halaman, dan untuk situs baru juga membangun struktur berdasarkan mereka, yaitu bagian, kategori). Nah, sekali lagi kami akan melalui proses pengumpulan permintaan untuk setiap petugas pemadam kebakaran (termasuk dengan alat baru).

Manakah dari tahap pengumpulan inti semantik yang paling penting?

Dengan sendirinya, kumpulan kueri (dasar inti semantik) untuk situs yang akan datang atau yang sudah ada adalah proses yang agak menarik (sebagai siapa pun, tentu saja) dan dapat diimplementasikan dalam beberapa cara, yang hasilnya kemudian dapat digabungkan ke dalam satu daftar besar (dengan membersihkan duplikat, menghapus dot dengan kata-kata berhenti).

Misalnya, Anda dapat secara manual mulai menyiksa Wordstat, dan selain itu, hubungkan Keycollector (atau disonannya versi gratis). Namun, semuanya bagus ketika Anda kurang lebih akrab dengan topik dan mengetahui kunci yang dapat Anda andalkan (mengumpulkan turunannya dan kueri serupa dari kolom kanan Wordstat).

Jika tidak (ya, dan bagaimanapun tidak ada salahnya), Anda bisa mulai dengan alat "gerinda kasar". Sebagai contoh, Serpstat(nee Prodvigator), yang memungkinkan Anda untuk benar-benar "merampok" pesaing Anda untuk kata kunci yang mereka gunakan (lihat). Ada layanan "pesaing perampok" serupa lainnya (spywords, keys.so), tetapi saya "terjebak" dengan Prodvigator sebelumnya.

Pada akhirnya, ada juga Bukvaris gratis, yang memungkinkan Anda untuk mulai mengumpulkan permintaan dengan sangat cepat. Anda juga dapat memesan unduhan pribadi dari database Ahrefs yang mengerikan dan sekali lagi mendapatkan kunci pesaing Anda. Secara umum, ada baiknya mempertimbangkan segala sesuatu yang dapat membawa setidaknya sebagian kecil dari permintaan yang berguna untuk promosi di masa depan, yang kemudian tidak akan terlalu sulit untuk dibersihkan dan digabungkan menjadi satu besar (seringkali bahkan daftar besar).

Kami akan mempertimbangkan semua ini (secara umum, tentu saja) sedikit lebih rendah, tetapi pada akhirnya pertanyaan utama selalu muncul - apa yang harus dilakukan selanjutnya. Faktanya, menakutkan bahkan hanya untuk mendekati apa yang kami dapatkan sebagai hasilnya (setelah merampok selusin atau dua pesaing dan menggores bagian bawah laras dengan Pengumpul Kunci). Kepala mungkin meledak karena mencoba memecah semua kueri ini (kata kunci) menjadi halaman terpisah dari situs yang akan datang atau yang sudah ada.

Kueri mana yang berhasil hidup berdampingan di satu halaman, dan kueri mana yang bahkan tidak boleh dicoba untuk digabungkan? Pertanyaan yang sangat sulit, yang sebelumnya saya selesaikan secara intuitif, karena menganalisis secara manual penerbitan Yandex (atau Google) tentang masalah "bagaimana dengan pesaing" secara manual buruk, dan opsi otomatisasi tidak tersedia. Nah, untuk saat ini. Namun demikian, alat seperti itu "muncul" dan hari ini akan dibahas di bagian akhir artikel.

Ini bukan layanan online, tapi solusi perangkat lunak, yang distribusinya dapat diunduh di halaman utama situs resmi (versi demo).

Oleh karena itu, tidak ada batasan jumlah permintaan yang diproses - proses sebanyak yang Anda butuhkan (namun, ada nuansa dalam pengumpulan data). Versi berbayar harganya kurang dari dua ribu, yang, untuk tugas-tugas yang harus diselesaikan, tidak dapat dikatakan apa-apa (IMHO).

Tetapi kita akan berbicara tentang sisi teknis KeyAssort sedikit lebih rendah, tetapi di sini saya ingin mengatakan tentang diri saya sendiri prinsip yang memungkinkan Anda memecah daftar kata kunci(hampir berapa pun panjangnya) ke dalam kelompok, mis. satu set kata kunci yang dapat berhasil digunakan pada satu halaman situs (optimalkan teks, judul, dan massa tautan untuk mereka - terapkan keajaiban SEO).

Dapat informasi dari mana? Siapa yang akan memberi tahu Anda apa yang akan "padam" dan apa yang tidak akan bekerja dengan andal? Jelas, mesin pencari itu sendiri akan menjadi penasihat terbaik (dalam kasus kami, Yandex, sebagai gudang pertanyaan komersial). Cukup dengan melihat volume besar keluaran data (katakanlah, analisis TOP 10) untuk semua kueri ini (dari daftar kumpulan benih masa depan) dan pahami apa yang berhasil digabungkan oleh pesaing Anda dalam satu halaman. Jika tren ini berulang beberapa kali, maka kita dapat berbicara tentang suatu pola, dan atas dasar itu, sudah dimungkinkan untuk memasukkan kunci ke dalam kelompok.

KeyAssort memungkinkan Anda untuk mengatur "ketatasan" dengan cluster yang akan dibentuk dalam pengaturan (pilih kunci yang dapat digunakan pada satu halaman). Misalnya, untuk perdagangan, masuk akal untuk memperketat persyaratan seleksi, karena penting untuk mendapatkan hasil yang terjamin, meskipun dengan mengorbankan biaya yang sedikit lebih tinggi untuk menulis teks untuk lagi cluster. Untuk situs informasi, sebaliknya, Anda dapat membuat beberapa konsesi untuk mendapatkan lalu lintas yang berpotensi lebih banyak dengan sedikit usaha (dengan risiko "non-burnout" yang sedikit lebih tinggi). Mari kita bicara tentang bagaimana melakukannya lagi.

Tetapi bagaimana jika Anda sudah memiliki situs dengan banyak artikel, tetapi Anda ingin memperluas benih yang ada dan mengoptimalkan artikel yang ada untuk jumlah kata kunci yang lebih besar agar mendapatkan lebih banyak lalu lintas dengan upaya yang minimal (sedikit menggeser penekanan kata kunci)? Program ini juga memberikan jawaban untuk pertanyaan ini - Anda dapat membuat kueri yang halaman yang ada sudah dioptimalkan, membuat penanda, dan di sekitarnya KeyAssort akan menyusun cluster dengan kueri tambahan yang cukup berhasil dipromosikan (pada satu halaman) oleh Anda pesaing dalam masalah tersebut. Menarik bagaimana kelanjutannya...

Bagaimana cara mengumpulkan kumpulan permintaan tentang topik yang Anda butuhkan?

Inti semantik apa pun sebenarnya dimulai dengan pengumpulan sejumlah besar permintaan, yang sebagian besar akan dibuang. Tetapi hal utama adalah bahwa pada tahap awal, "mutiara" itu masuk ke dalamnya, di mana setiap halaman situs masa depan atau yang ada akan dibuat dan dipromosikan. Pada tahap ini, mungkin, yang paling penting adalah mengumpulkan sebanyak mungkin permintaan yang sesuai dan tidak melewatkan apa pun, dan kemudian dengan mudah menyingkirkan yang kosong.

Ada pertanyaan yang wajar, alat apa yang digunakan? Ada satu jawaban tegas dan sangat benar - berbeda. Lebih besar lebih baik. Namun, metode pengumpulan inti semantik ini mungkin harus dicantumkan dan diberikan penilaian dan rekomendasi umum untuk penggunaannya.

- Yandex Wordstat dan rekan-rekannya di mesin pencari lainnya - awalnya alat ini ditujukan untuk mereka yang menempatkan iklan kontekstual sehingga mereka dapat memahami seberapa populer frasa tertentu di kalangan pengguna mesin telusur. Nah, jelas bahwa SEO juga menggunakan alat ini dan sangat berhasil. Saya dapat merekomendasikan untuk melihat artikel tersebut, serta artikel yang disebutkan di awal publikasi ini (ini akan berguna untuk pemula).

Di antara kekurangan Vodstat, orang dapat mencatat:

- Sejumlah besar pekerjaan manual (pasti membutuhkan otomatisasi dan akan dibahas nanti), baik dalam frase meninju berdasarkan kunci, dan dalam meninju pertanyaan asosiatif dari kolom kanan.

- Membatasi penerbitan Wordstat (2000 kueri dan tidak lebih dari satu baris) dapat menjadi masalah, karena untuk beberapa frasa (misalnya, "bekerja") ini sangat kecil dan kami melupakan frekuensi rendah, dan kadang-kadang bahkan frekuensi menengah kueri yang dapat menghasilkan lalu lintas dan pendapatan yang baik (banyak orang melewatkannya). Anda harus "banyak meregangkan kepala", atau menggunakan metode alternatif (misalnya, basis data kata kunci, salah satunya akan kami pertimbangkan di bawah - dan gratis!).

- Kay Kolektor(dan adik laki-lakinya yang bebas Slovoeb) - beberapa tahun yang lalu, kemunculan program ini hanyalah "penyelamatan" bagi banyak pekerja jaringan (dan bahkan sekarang agak sulit membayangkan mengerjakan benih tanpa QC). Lirik. Saya membeli KK dua atau tiga tahun yang lalu, tetapi saya menggunakannya paling banyak selama beberapa bulan, karena program ini terkait dengan perangkat keras (isian komputer), dan saya mengubahnya beberapa kali dalam setahun. Secara umum, memiliki lisensi untuk KK, saya menggunakan SE - jadi itulah yang menyebabkan kemalasan.

Anda dapat membaca detailnya di artikel "". Kedua program akan membantu Anda mengumpulkan kueri dari kolom kanan dan kiri Wordstat, serta saran pencarian untuk frasa kunci yang Anda butuhkan. Petunjuk adalah apa yang keluar dari string pencarian saat Anda mulai mengetik kueri. Pengguna sering tidak menyelesaikan set hanya memilih opsi yang paling cocok dari daftar ini. Seoshniks telah menemukan ini dan menggunakan kueri seperti itu dalam pengoptimalan dan bahkan.

QC dan SE memungkinkan Anda untuk segera mengetik kumpulan permintaan yang sangat besar (walaupun mungkin memakan waktu lama, atau membeli batas XML, tetapi lebih dari itu di bawah) dan dengan mudah menyingkirkan boneka, misalnya, dengan memeriksa frekuensi frasa di tanda kutip (pelajari materi jika Anda tidak mengerti tentang pidato - tautan di awal publikasi) atau dengan menetapkan daftar kata henti (terutama relevan untuk perdagangan). Setelah itu, seluruh kumpulan kueri dapat dengan mudah diekspor ke Excel untuk pekerjaan selanjutnya atau untuk loading ke KeyAssort (clusterer), yang akan dibahas di bawah ini.

- SerpStat(dan layanan serupa lainnya) - memungkinkan Anda memasukkan URL situs Anda untuk mendapatkan daftar pesaing Anda untuk penerbitan Yandex dan Google. Dan untuk masing-masing pesaing ini akan mungkin untuk mendapatkan daftar lengkap kata kunci yang berhasil mereka tembus dan mencapai ketinggian tertentu (dapatkan lalu lintas dari mesin pencari). Tabel pivot akan berisi frekuensi frasa, tempat situs di atasnya di bagian Atas dan banyak informasi lain yang berguna dan tidak terlalu berguna.

Belum lama ini, saya menggunakan paket tarif Serpstat yang hampir paling mahal (tetapi hanya untuk satu bulan) dan berhasil menghemat hampir satu gigabyte berbagai hal berguna di Excel selama ini. Saya tidak hanya mengumpulkan kunci pesaing, tetapi juga hanya kumpulan kueri untuk frasa kunci yang saya minati, dan juga mengumpulkan tujuh benih halaman paling sukses dari pesaing saya, yang menurut saya juga sangat penting. Satu hal yang buruk - sekarang saya tidak dapat menemukan waktu untuk mengatasi pemrosesan semua informasi yang sangat berharga ini. Tetapi ada kemungkinan bahwa KeyAssort masih akan menghilangkan mati rasa di depan raksasa data yang perlu diproses.

- bukvariks adalah database kata kunci gratis dalam cangkang perangkat lunaknya sendiri. Pemilihan kata kunci membutuhkan waktu sepersekian detik (mengunggah ke menit Excel). Saya tidak ingat berapa juta kata yang ada, tetapi ulasan tentangnya (termasuk milik saya) sangat bagus, dan yang paling penting, semua kekayaan ini gratis! Benar, paket distribusi program berbobot 28 Gigabytes, dan ketika dibongkar, basis data menempati lebih dari 100 GB pada hard disk, tetapi ini semua sepele dibandingkan dengan kesederhanaan dan kecepatan mengumpulkan kumpulan permintaan.

Namun bukan hanya kecepatan pengumpulan benih yang menjadi nilai plus utama dibandingkan Wordstat dan KeyCollector. Hal utama adalah bahwa tidak ada batasan pada 2000 baris untuk setiap permintaan, yang berarti bahwa tidak ada frekuensi rendah dan di luar frekuensi rendah yang akan lolos dari kita. Tentu saja, frekuensi dapat diklarifikasi sekali lagi melalui QC yang sama dan disaring menggunakan stopword, tetapi Bukvariks melakukan tugas utamanya dengan luar biasa. Benar, mengurutkan berdasarkan kolom tidak berfungsi untuknya, tetapi dengan menyimpan kumpulan kueri di Excel, dimungkinkan untuk mengurutkannya sesuka Anda.

Mungkin, setidaknya beberapa alat katedral kolam renang permintaan "serius" akan Anda berikan di komentar, dan saya akan berhasil meminjamnya ...

Bagaimana cara menghapus kueri pencarian yang dikumpulkan dari "dummy" dan "sampah"?

Daftar yang diperoleh sebagai hasil manipulasi yang dijelaskan di atas kemungkinan besar akan sangat besar (jika tidak besar). Oleh karena itu, sebelum memuatnya ke dalam clusterer (bagi kami itu adalah KeyAssort) masuk akal untuk membersihkannya sedikit. Untuk melakukan ini, kumpulan kueri, misalnya, dapat diturunkan ke keycollector dan dihapus:

- Permintaan dengan frekuensi terlalu rendah (saya pribadi menerobos frekuensi dalam tanda kutip, tetapi tanpa tanda seru). Terserah Anda untuk memutuskan ambang mana yang akan dipilih, dan dalam banyak hal itu tergantung pada subjek, kompetisi, dan jenis sumber daya yang digunakan benih.

- Untuk kueri komersial, masuk akal untuk menggunakan daftar kata berhenti (seperti "gratis", "unduh", "abstrak", serta, misalnya, nama kota, tahun, dll.) untuk menghapus dari benih terlebih dahulu apa yang diketahui tidak akan membawa pembeli target ke situs (menyingkirkan gratis, mencari informasi, dan bukan produk, yah, dan penduduk daerah lain, misalnya).

- Terkadang masuk akal untuk dipandu oleh indikator persaingan dalam hal penyaringan. permintaan ini dalam masalah. Misalnya, atas permintaan "jendela plastik" atau "AC", Anda bahkan tidak perlu mengguncang perahu - kegagalan dijamin di muka dan dengan jaminan 100%.

Katakan bahwa itu terlalu sederhana dalam kata-kata, tetapi sulit dalam praktiknya. Dan di sini tidak. Mengapa? Tapi karena satu orang yang saya hormati (Mikhail Shakin) tidak meluangkan waktu dan merekam video dengan detail deskripsi tentang cara membersihkan kueri pencarian di Kolektor Kunci:

Terima kasih kepadanya untuk ini, karena pertanyaan-pertanyaan ini jauh lebih mudah dan lebih jelas untuk ditunjukkan daripada dijelaskan dalam artikel. Secara umum, Anda bisa melakukannya, karena saya percaya pada Anda ...

Menyiapkan pengelompokan benih KeyAssort untuk situs web Anda

Sebenarnya, yang paling menarik dimulai. Sekarang semua daftar kunci yang sangat besar ini perlu entah bagaimana rusak (tersebar) pada halaman terpisah di masa depan atau situs Anda yang ada (yang ingin Anda tingkatkan secara signifikan dalam hal lalu lintas yang dibawa dari mesin pencari). Saya tidak akan mengulangi diri saya dan berbicara tentang prinsip dan kompleksitas proses ini, karena itulah mengapa saya menulis bagian pertama artikel ini.

Jadi metode kami cukup sederhana. Kami pergi ke situs web resmi KeyAssort dan unduh versi demo untuk mencoba program untuk gigi (perbedaan antara demo dan versi lengkap adalah ketidakmampuan untuk membongkar, yaitu mengekspor benih yang dikumpulkan), dan setelah itu dimungkinkan untuk membayar (1900 rubel tidak cukup, tidak cukup menurut realitas modern). Jika Anda ingin segera mulai mengerjakan inti, yang disebut "untuk salinan bersih", maka lebih baik memilih versi lengkap dengan kemungkinan ekspor.

Program KeyAssort sendiri tidak dapat mengumpulkan kunci (sebenarnya, ini bukan hak prerogatifnya), dan oleh karena itu kunci tersebut perlu dimuat ke dalamnya. Ini dapat dilakukan dengan empat cara - secara manual (mungkin masuk akal untuk menggunakan metode ini untuk menambahkan beberapa kunci yang sudah ditemukan setelah kumpulan kunci utama), serta tiga cara batch untuk mengimpor kunci:

- dalam format txt - ketika Anda hanya perlu mengimpor daftar kunci (masing-masing pada baris terpisah dari file txt dan ).

- serta dua varian format Excel: dengan parameter yang Anda butuhkan di masa mendatang, atau dengan situs yang dikumpulkan dari TOP10 untuk setiap kunci. Yang terakhir ini dapat mempercepat proses clustering, karena program KeyAssort tidak harus mengurai output itu sendiri untuk mengumpulkan data ini. Namun, URL dari TOP10 harus segar dan akurat (versi daftar seperti itu dapat diperoleh, misalnya, di Pengumpul Kunci).

Ya, apa yang saya katakan - lebih baik untuk melihat sekali:

Bagaimanapun, pertama-tama ingatlah untuk membuat proyek baru di menu "File" yang sama, dan baru kemudian fungsi impor akan tersedia:

Mari kita lihat pengaturan program (ada sangat sedikit dari mereka), karena untuk berbagai jenis situs, satu set pengaturan yang berbeda mungkin optimal. Buka tab "Layanan" - "Pengaturan program" dan Anda dapat langsung pergi ke tab "Kekelompokan":

Yang paling penting di sini adalah, mungkin, memilih jenis pengelompokan yang Anda butuhkan. Program ini dapat menggunakan dua prinsip di mana permintaan digabungkan ke dalam kelompok (cluster) - keras dan lunak.

- Keras - semua permintaan yang termasuk dalam satu grup (cocok untuk promosi di satu halaman) harus digabungkan pada satu halaman untuk jumlah pesaing yang diperlukan dari Top (angka ini ditentukan dalam baris "kekuatan grup").

- Lunak - semua permintaan yang termasuk dalam grup yang sama sebagian akan terjadi pada halaman yang sama untuk jumlah pesaing yang diperlukan dan Top (angka ini juga diatur dalam garis "kekuatan pengelompokan").

Ada gambar yang bagus dengan jelas menggambarkan ini:

Jika tidak jelas, maka tidak apa-apa, karena ini hanya penjelasan prinsip, dan yang penting bagi kami bukanlah teori, tetapi praktik, yang mengatakan bahwa:

- Pengelompokan keras paling baik digunakan untuk situs komersial. Metode ini memberikan akurasi yang tinggi, karena kemungkinan mencapai bagian atas kueri yang digabungkan pada satu halaman situs akan lebih tinggi (dengan pendekatan yang tepat untuk mengoptimalkan teks dan promosinya), meskipun akan ada lebih sedikit kueri sendiri di cluster, yang berarti ada lebih banyak cluster itu sendiri (lebih banyak halaman harus dibuat dan dipromosikan).

- Pengelompokan lunak masuk akal untuk digunakan untuk situs informasi, karena artikel akan didapatkan dengan indikator kelengkapan yang tinggi (akan dapat menjawab sejumlah permintaan pengguna yang memiliki kesamaan makna), yang juga diperhitungkan dalam pemeringkatan. Dan halamannya sendiri akan lebih kecil.

Penting lainnya, menurut saya, pengaturan adalah tanda centang di kotak "Gunakan Frase Penanda". Mengapa ini mungkin diperlukan? Ayo lihat.

Katakanlah Anda sudah memiliki situs web, tetapi halaman di dalamnya dioptimalkan bukan untuk kumpulan kueri, tetapi untuk satu, atau Anda menganggap kumpulan ini tidak cukup besar. Pada saat yang sama, Anda dengan sepenuh hati ingin memperluas benih tidak hanya dengan menambahkan halaman baru, tetapi juga dengan meningkatkan yang sudah ada (ini masih lebih mudah dalam hal implementasi). Jadi perlu untuk setiap halaman tersebut untuk mendapatkan benih "sampai penuh".

Untuk itulah pengaturan ini. Setelah mengaktifkannya, Anda dapat memberi tanda centang di sebelah setiap frasa dalam daftar permintaan Anda. Anda hanya perlu menemukan kueri utama yang telah Anda optimalkan halaman yang ada di situs Anda (satu per halaman) dan program KeyAssort akan membangun cluster di sekitarnya. Sebenarnya, semuanya. Selengkapnya di video ini:

Hal penting lainnya (untuk operasi yang benar program) mengatur hidup di tab "Pengumpulan data dari Yandex XML". bisa anda baca pada artikel dibawah ini. Singkatnya, SEO terus-menerus mengurai hasil Yandex dan Wordstat, menciptakan beban yang berlebihan pada kapasitasnya. Untuk perlindungan, captcha diperkenalkan, dan akses khusus dikembangkan melalui XML, di mana captcha tidak akan keluar lagi dan data tidak akan terdistorsi oleh kunci yang diperiksa. Benar, jumlah cek seperti itu per hari akan sangat dibatasi.

Apa yang menentukan jumlah batas yang dialokasikan? Bagaimana Yandex mengevaluasi file . Anda dapat mengikuti tautan ini (berada di browser yang sama tempat Anda diotorisasi di Ya.Webmaster). Misalnya, terlihat seperti ini untuk saya:

Ada juga grafik distribusi batas berdasarkan waktu di bawah ini, yang juga penting. Jika Anda perlu menerobos banyak permintaan, dan ada sedikit batasan, maka ini bukan masalah. Mereka dapat dibeli. Bukan Yandex, tentu saja, secara langsung, tetapi mereka yang memiliki batasan ini, tetapi mereka tidak membutuhkannya.

Mekanisme XML Yandex memungkinkan transfer batas, dan pertukaran yang telah menjadi perantara membantu mengotomatiskan semua ini. Misalnya, pada XMLProxy Anda dapat membeli batas hanya dengan 5 rubel per 1000 permintaan, yang, Anda lihat, sama sekali tidak mahal.

Tapi itu tidak masalah, karena batas yang Anda beli akan tetap mengalir ke "akun" Anda, tetapi untuk menggunakannya di KeyAssort, Anda harus pergi ke " Pengaturan" dan salin tautan panjang ke bidang "URL untuk permintaan" (jangan lupa klik "IP Anda saat ini" dan klik tombol "Simpan" untuk mengikat kunci ke komputer Anda):

Setelah itu, yang tersisa hanyalah memasukkan URL ini ke jendela dengan pengaturan KeyAssort di bidang "Url untuk permintaan":

Sebenarnya, semuanya sudah selesai dengan pengaturan KeyAssort - Anda dapat mulai mengelompokkan inti semantik.

Pengelompokan kata kunci di KeyAssort

Jadi, saya harap Anda telah mengatur semuanya (memilih jenis pengelompokan yang diinginkan, menghubungkan batas Anda sendiri atau yang dibeli dari Yandex XML), menemukan cara mengimpor daftar dengan kueri, dan berhasil mentransfer semuanya ke KeyAssort. Apa berikutnya? Dan kemudian, tentu saja, hal yang paling menarik adalah peluncuran pengumpulan data (Url situs dari 10 Teratas untuk setiap permintaan) dan pengelompokan selanjutnya dari seluruh daftar berdasarkan data ini dan pengaturan yang Anda buat.

Jadi, untuk memulai, klik tombol "Mengumpulkan data" dan tunggu dari beberapa menit hingga beberapa jam sementara program memindai Tops untuk semua permintaan dari daftar (semakin banyak, semakin lama menunggu):

Butuh waktu sekitar satu menit untuk membuat tiga ratus permintaan (ini adalah inti kecil untuk serangkaian artikel tentang bekerja di Internet). Setelah itu Anda sudah bisa lanjutkan langsung ke pengelompokan, tombol dengan nama yang sama pada toolbar KeyAssort akan tersedia. Proses ini sangat cepat, dan secara harfiah dalam beberapa detik saya mendapatkan seluruh rangkaian calster (grup), dirancang sebagai daftar bersarang:

Pelajari lebih lanjut tentang menggunakan antarmuka program, serta tentang membuat cluster untuk halaman situs yang ada terlihat lebih baik di video, karena jauh lebih jelas:

Semua yang kami inginkan, kami dapatkan, dan ingatkan Anda - otomatis penuh. Lepota.

Meskipun, jika Anda membuat situs baru, selain pengelompokan, itu sangat penting garis besar struktur masa depan situs(tentukan bagian/kategori dan distribusikan kelompok di antara mereka untuk halaman mendatang). Anehnya, tetapi cukup nyaman untuk melakukannya di KeyAssort, tetapi kenyataannya tidak lagi di mode otomatis, dan masuk mode manual. Bagaimana?

Sekali lagi, akan lebih mudah untuk melihat sekali lagi - semuanya diatur secara harfiah di depan mata kita hanya dengan menyeret kelompok dari jendela kiri program ke jendela kanan:

Jika Anda memang membeli program tersebut, Anda dapat mengekspor inti semantik yang dihasilkan (dan sebenarnya struktur situs masa depan) ke Excel. Selain itu, pada tab pertama dimungkinkan untuk bekerja dengan permintaan dalam bentuk daftar tunggal, dan pada tab kedua struktur yang Anda konfigurasikan di KeyAssort sudah akan disimpan. Sangat, sangat nyaman.

Yah, apa pun. Saya siap berdiskusi dan mendengar pendapat Anda tentang pengumpulan bibit untuk situs.

Semoga sukses untuk Anda! Sampai jumpa di situs halaman blog

Anda mungkin tertarik

vpodskazke- layanan baru Dalam tooltip untuk memajukan petunjuk dalam mesin pencari

Peringkat SE- layanan terbaik pemantauan posisi untuk pemula dan profesional di SEO Kumpulan inti semantik lengkap di Topvisor, berbagai cara untuk memilih kata kunci dan mengelompokkannya berdasarkan halaman Praktik mengumpulkan inti semantik untuk SEO dari seorang profesional - bagaimana hal itu terjadi dalam realitas saat ini tahun 2018 Optimasi faktor perilaku tanpa twist mereka SEO PowerSuite - program untuk pengoptimalan situs internal (WebSite Auditor, Rank Tracker) dan eksternal (SEO SpyGlass, LinkAssistant)  SERPClick: promosi berdasarkan faktor perilaku

SERPClick: promosi berdasarkan faktor perilaku

sushiandbox.ru Menguasai PC - Internet. Skype. Jaringan sosial. Pelajaran di Windows.

sushiandbox.ru Menguasai PC - Internet. Skype. Jaringan sosial. Pelajaran di Windows.